基于AI的知识整合

知识整合是将海量分散的生物医学信息转化为结构化、系统化且计算机可读知识的过程。生物医学知识整合存在着知识海量且碎片化、来源多样异质性强等难点和挑战。结合最新的AI技术发展,生物医学知识整合近年来取得了重大的突破。

知识整合的用途和必要性

- 提升知识获取的效率与全面性

- 建立不同领域概念间的复杂关联

- 支撑生物医学数据分析

- 知识推理、生成新的科学假设

知识整合的技术框架

我们构建了本体—大语言模型—知识图谱相结合的生物医学知识整合框架,并已开发了基于大语言模型的知识提取算法和生物医学知识图谱BMKG,并可基于GraphRAG技术结合知识图谱和大语言模型,提供智能化的知识检索应用。

知识图谱与大语言模型

知识图谱(KG)和大语言模型(LLM)都是用于表示和利用知识的人工智能技术,旨在使机器能够理解、存储和运用知识。

知识图谱KG

以图结构存储知识的数据库,其中节点代表实体(概念),边代表实体之间的关系。

- 以符号化的方式显式地表示知识

- 通过神经或/和符号的方式进行推理

Pros

- 准确、可溯源的知识

- 可解释性,知识显示存储,可给出推理的网络路径

- 可构建领域知识图谱,更新维护容易

Cons

- 知识不完整,覆盖面低

- 需要专门编程语言与其交互,无自然语言理解力

大语言模型LLM

基于深度学习的自然语言处理模型,通过学习海量文本数据中的统计规律来理解和生成自然语言。

- LLM 将知识隐式地存储在神经网络模型参数中,通过概率分布来表示知识

- 利用神经网络进行推理

Cons

- 幻觉问题,输出看似合理但实则错误的知识

- 黑箱,存储和推理都基于神经网络

- 预训练模型,缺乏领域专门知识和实施更新的知识

Pros

- 通识性和泛化能力

- 强大的自然语言处理能力

核心技术介绍

基于大语言模型的知识提取算法

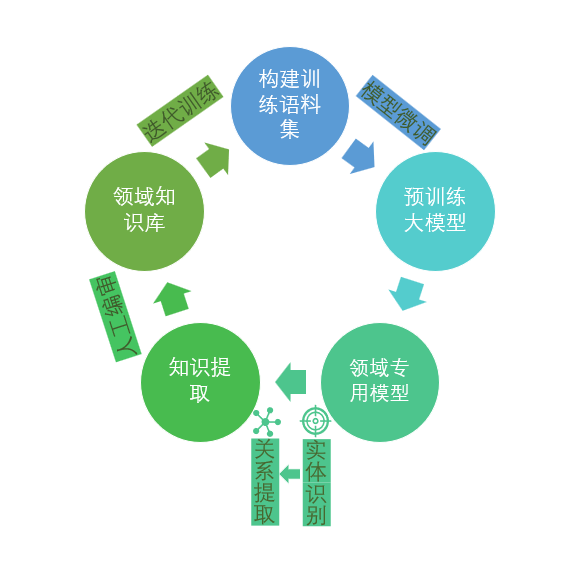

技术流程

我们开发的技术流程可高效、准确地从海量文献中提取知识,具体步骤如下:

- 构建语料集,对预训练的通用大模型进行微调,增强大模型的专业领域知识和完成专门任务的能力

- 利用训练好的模型通过实体识别——关系提取两个步骤从文献中提取知识

- 对模型的提取结果进行人工编审,核验和修正错误的结果

- 将编审后的结果储存入领域知识库,后续可通过开发网页查询功能、整合入知识图谱等方式进行应用

- 编审后的结果用于模型的迭代训练,持续优化模型性能

技术优势

- 领域专业性强——通过微调增强了模型在特定领域的专业知识和任务能力

- 准确性高——过实体识别和关系提取的解耦以及人工编审的质量保障,提高了提取结果的准确性

- 可持续优化—— 通过闭环迭代的训练方式,能够不断提升模型性能

- 可扩展性好——通过微调模型即可将流程移植到不同专业领域

了解更多

算法与应用:尿液生物标志物数据库构建,点击跳转

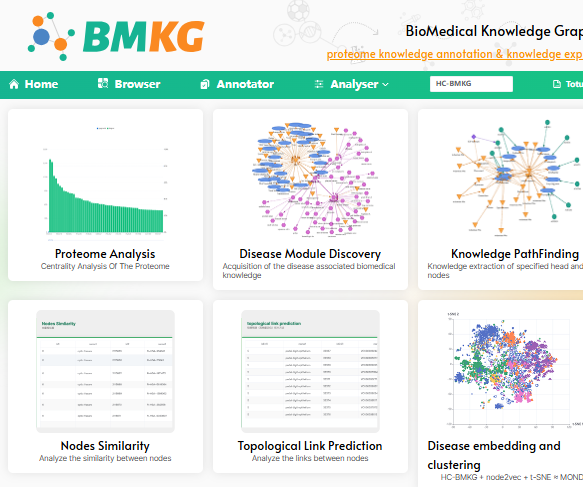

BMKG生物医学知识图谱

我们与中国医学科学院基础医学研究所合作构建了大规模生物医学知识图谱(BMKG),该图谱涵盖疾病、表型、基因、蛋白、通路、药物、人体解剖结构等九大类实体,包含250余万个节点和超过2500万条关系。

基于BMKG,并整合特定领域知识库和图谱,可为垂直领域的知识整合与发现提供强大支持。

GraphRAG增强知识检索

技术介绍

GraphRAG (图检索增强生成) 是一种改进的检索增强生成 (RAG) 技术,它通过结合知识图谱来提升大型语言模型的性能,尤其在处理复杂问题和需要多步推理的场景下表现出色。

用户输入问题后,graphRAG首先利用大语言模型对问题进行优化,生成一个、多个或迭代的图检索任务,将检索结果汇集成子知识图谱,最后利用大语言模型结合问题和检索到的知识生成答案。

graphRAG技术流程

技术优势

- 准确性高——以专业的领域知识图谱作为信息来源,克服了大语言模型的“幻觉”问题

- 复杂推理能力——知识图谱中构建了概念的复杂关系,提升了大语言模型的推理能力

- 可解释和可溯源——可以提供推理过程在知识图谱中的路径和信息源,使用户更易理解推理的逻辑以及溯源知识的可靠性

- 易于知识更新和维护——通过维护知识图谱来进行知识更新和维护,无需重新训练大语言模型

- 用户友好型——用户无需学习知识图谱技术,即可以自然语言提问和获取答案